自動運転の視力をもっとクリアに! ~仮想空間シミュレータDIVPの、センサ応用研究への活用~ ( 先進自動車研究所 学内特別研究員 天野 義久 )

神奈川工科大学 先進自動車研究所では、自動運転車の開発を支える「仮想空間シミュレータDIVP(Driving Intelligence Validation Platform)」を開発してきました(※1)。

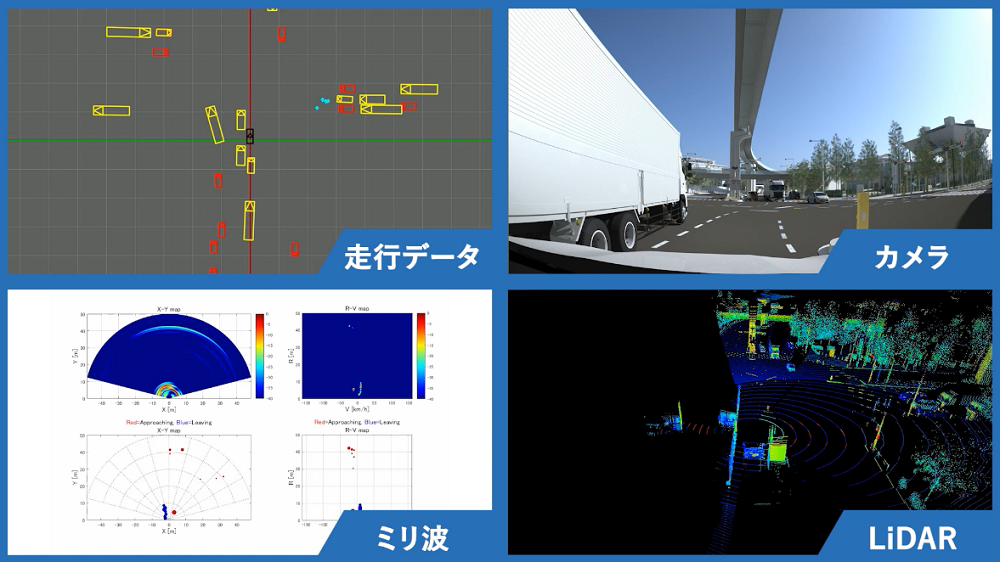

自動運転では各種センサ(カメラ、LiDAR(ライダー)、ミリ波レーダ)が「眼」の役割を担います。

DIVPでは、それら各種センサと走行環境を仮想空間として忠実に再現できるため、各種センサの開発を効率よく行うことができます。

今回の記事では、DIVPが各種センサ(特にミリ波レーダ)の応用研究のプラットフォームとしても有効であることを示します。

DIVPについては以下の記事をご覧ください。

自動運転の「眼」となる三大センサ

自動運転で「眼」の役割を担うカメラ、LiDAR、ミリ波レーダは「三種の神器」とまで呼ばれる主要センサです(表1)。

表1 自動運転車の「眼」となる3つのセンサ

| カメラ | 可視光(波長380~770nmの電磁波)を使用 |

| LiDAR | 近赤外線(波長850~1550nmの電磁波)を使用 |

| ミリ波レーダ | ミリ波電波(波長4~12mmの電磁波)を使用 |

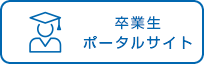

このうちカメラとLiDARは、直感的に理解し易くて性能も良く、真っ先に自動運転車に搭載されました。しかしミリ波レーダは、直感的に理解しにくく性能も劣るため、自動運転界では活用が遅れています(図1)。

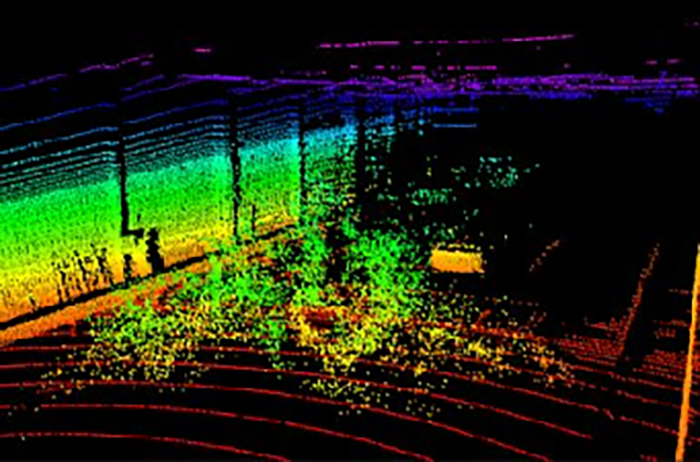

(左)カメラ(中)LiDAR(右)ミリ波レーダ

図1 カメラ(左)やLiDAR(中)では周りの車や車道といった情報が直感的に理解できるが、ミリ波レーダ(右)は何を表しているのかを直感的に理解することが難しい

しかし、運転者を必要としない実証実験が開始されるなど、いよいよ迫った自動運転車の社会実装を考えると、このミリ波レーダがどうしても必要な場面が出てきます。

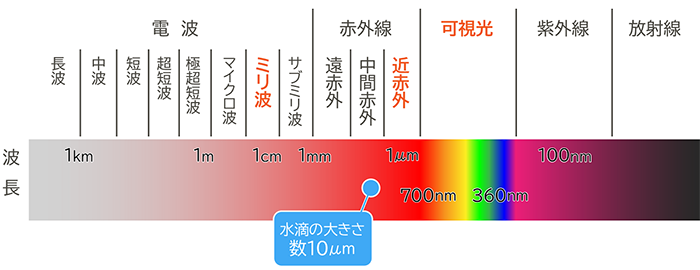

例えば図2は濃霧の中でのカメラとLiDARによる実験の様子です。可視光、近赤外線、ミリ波電波は全て電磁波の一種なのですが、それぞれ波長が異なります。水滴と電磁波の波長の大小関係によって反射率や透過率は大きく異なり、水滴よりも短い波長を使用するカメラとLiDARは水滴(霧)が映り込み視界が遮られてしまいます。霧を透過して視界を確保できるのは水滴に対して波長の長いミリ波レーダだけです(図3)。安全の観点から我々は、ミリ波レーダの活用が進まない現状を憂慮してきました。

図2(左) 霧中のカメラ画像:視界がかすんでしまい前方の車が良く見えない

(右)霧中のLiDAR画像:水滴が映り込み前方の車が見えづらくなっている

図3 電磁波の種類

水滴の大きさは数10μmのため、それよりも波長の短い可視光を使うカメラと近赤外線を使うLiDARでは水滴(霧)が映り込んで視界を遮ってしまうが、10μmより波長の長いミリ波電波を使うミリ波レーダであれば霧を透過するため視界を確保することができる

急速に進歩するミリ波レーダ技術

表2 ミリ波レーダに関係する技術革新

| 第1の技術革新 | ハードウェア | CMOSワンチップ化等 |

| 第2の技術革新 | ソフトウェア | 高分解能アルゴリズム、深層学習等 |

| 第3の技術革新 | デジタルツイン | 仮想空間シミュレーション |

実は、ミリ波レーダ技術は近年急激な進歩を続けており、技術者としては非常に面白い時代にあると感じています。高価・装置が大きい・操作が難しいといった理由から、わずか10年前までは、ミリ波レーダを搭載した乗り物と言えば、ジェット戦闘機や軍艦ぐらいでした。それが、第1の技術革新(ハードウェア)によって安価・小型・手軽になり、普通の乗用車にミリ波レーダが当たり前に載る時代になりました。カメラやLiDARより劣っていた画質も、第2の技術革新(ソフトウェア)によって改善が続いています。

そんな中、神奈川工科大学 先進自動車研究所が開発した「仮想空間シミュレータDIVP(図4)」が、第3の技術革新(デジタルツイン※2)を起こしました。これにより、自動運転界におけるミリ波レーダの活用を大きく推進できると考えています。「仮想空間シミュレータ」とは、コンピュータ内の仮想世界に忠実に再現した街の中で、実験対象となるセンサを搭載した車を走らせ、レイトレーシング(※3)等の手法を用いてセンサの出力を計算する技術です。

ミリ波レーダを使って実験を行う場合、電波法に基づく技術基準適合証明を取得する必要があるなど、ミリ波レーダは初心者には実験のハードルが高い機器です。しかし、仮想空間シミュレータを使えば、ミリ波レーダの初心者でも簡単に仮想実験を行うことができ、ミリ波レーダの計測結果を使った応用研究へと一気に進むことができます。

図4 仮想空間シミュレータDIVPによる実験の様子

各種センサの仮想実験を初心者でも簡単に行え、結果を得ることができる

応用研究の具体例

自動運転車において各センサの一番の役目は、走行中に刻一刻と変化する周辺障害物の地図を作成することです。それを基に、人工知能がルートを選択します。

時々刻々と変化する周辺障害物の地図を作成するためには、基本となる地図が必要です。

これまで紹介した研究ではセンサで見える全てを映し出していましたが、地図作成では「道路」という必要な情報だけを取り出して映し出す技術が必要になります。

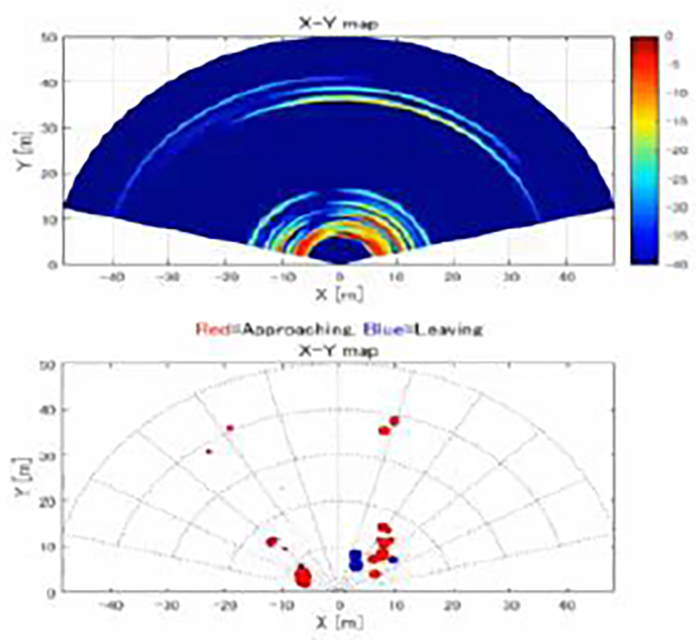

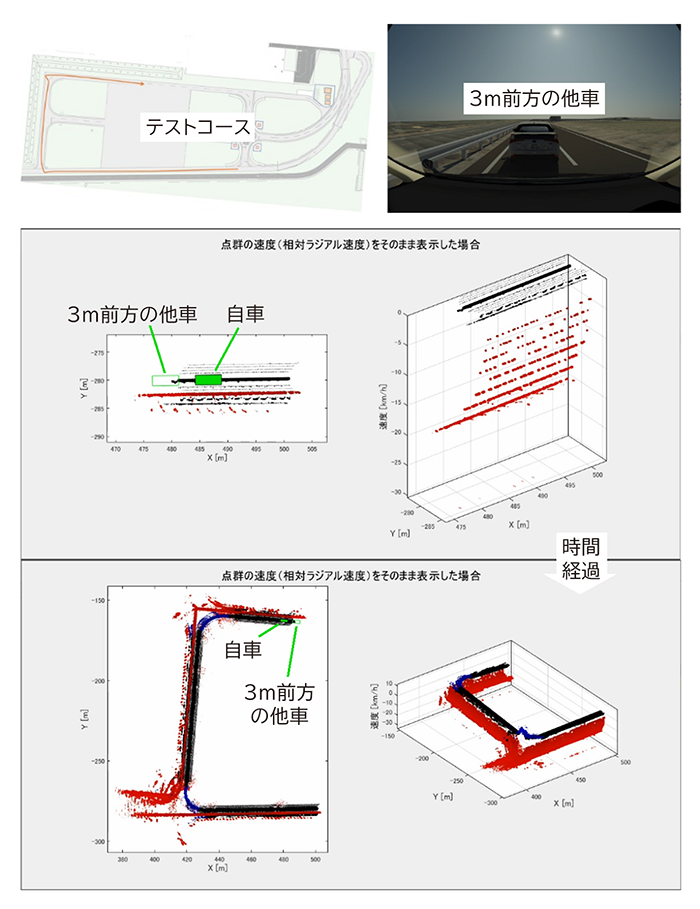

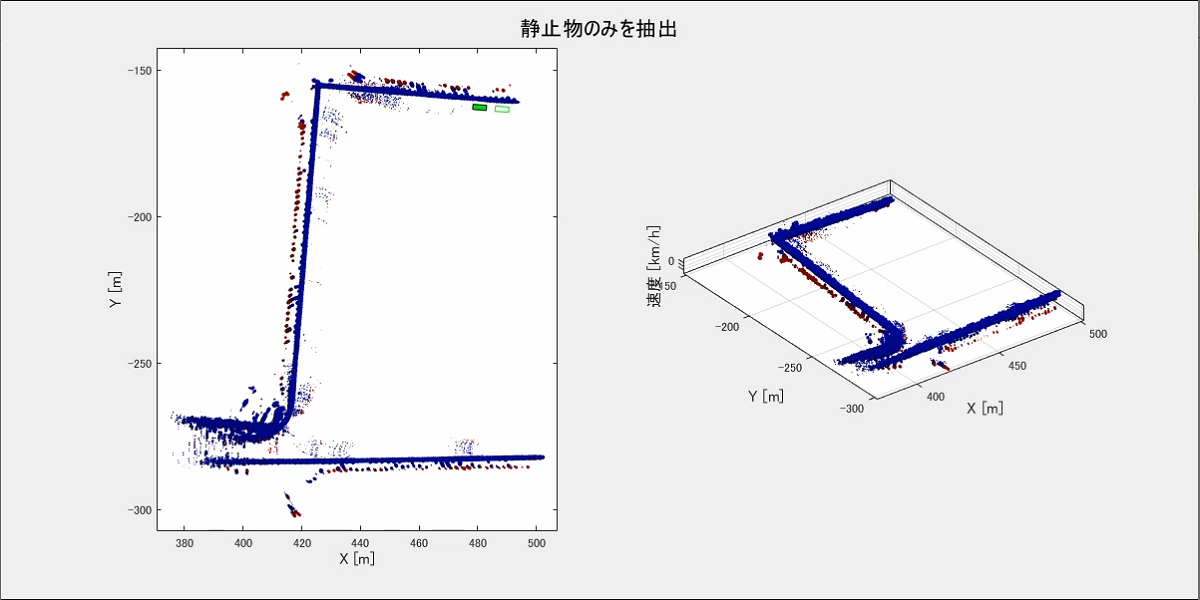

例えば図5はその最初のステップとしてDIVP内のテストコースを周回しながら、ミリ波レーダで自動的に簡易地図を作成させた例です。ところがこの地図には、自車の前方3mを並走していた他の車の軌跡(黒線)も映り込んでしまいます。いつも居るわけではない車は地図にとって邪魔者です。「邪魔な映り込みを自動消去する信号処理研究」という課題にぶつかったわけですが、「仮想空間シミュレータDIVP」を使えば、この信号処理研究の段階へと一気に進むことができるのです。

図5 ミリ波レーダによる地図作成の例

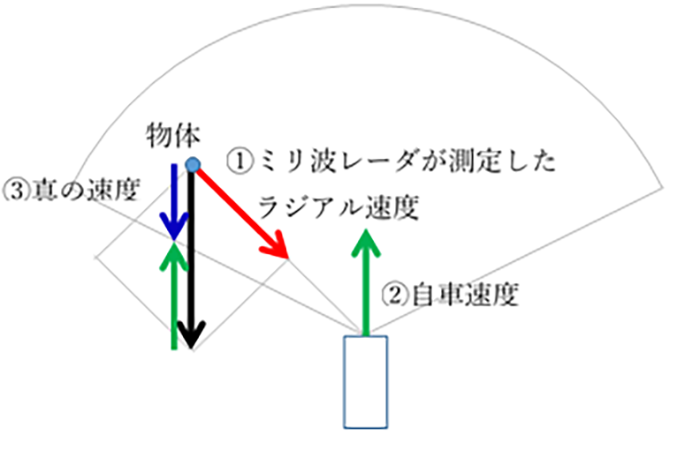

ミリ波レーダが測定できる速度は図6の「ラジアル速度」(①)と呼ばれる見掛け上の相対速度なのですが、図6に基づいてベクトル演算を行えば、物体の「真の速度」(③)を推定できます。

図6 速度ベクトルの関係

図5の結果から速度ゼロ付近の静止物のみを抽出した最終結果が図7です。目論見通り、邪魔な他車の軌跡だけを消去した地図が得られました。このようなミリ波レーダで作成した「基本の地図」があれば、例えば霧が出ている時でも、時々刻々と変化する障害物を正しく検知することができます。

図7 信号処理結果

他車の軌跡を消去した「基本となる地図」が作成できた

今後

自動運転はカメラ、LiDAR、ミリ波レーダという3つの「眼」によってどんな時でもクリアな視界を得ることができます。今後も「仮想空間シミュレータDIVP」を使い、ミリ波レーダの高精度化や3値デジタル化といった自動運転でニーズが高い技術のサンプル開発に努め、自動運転界でのミリ波レーダ活用を促して行きます。それにより、DIVPがセンサ応用研究のプラットフォームとして有効であることを示して行きます。

※1 仮想空間シミュレータDIVPは、神奈川工科大学/井上秀雄特任教授がリーダ機関/プロジェクトリーダとなり、2018年12月から内閣府の事業「戦略的イノベーション創出プログラムSIP第2期自動運転」の採択プロジェクトとして推進し、開発してきた。

※2 デジタルツイン:現実世界の情報を基に、デジタルな仮想世界にその複製を構築し、様々なシミュレーションを行う技術のこと。

※3 レイトレーシング:光源から出ている光の量や方向を把握し、物体の表面や水滴などで起こる光の屈折や反射といった様々な影響を計算して現実と同じ状態を作り出す技術。

▼関連するSDGs

3 すべての人に健康と福祉を

7 エネルギーをみんなにそしてクリーンに

9 産業と技術革新の基盤をつくろう

10 人や国の不平等をなくそう